IA está criando Deepfakes que estão ficando perigosamente convincentes, especialistas explicam por que isso ameaça a confiança no que vemos

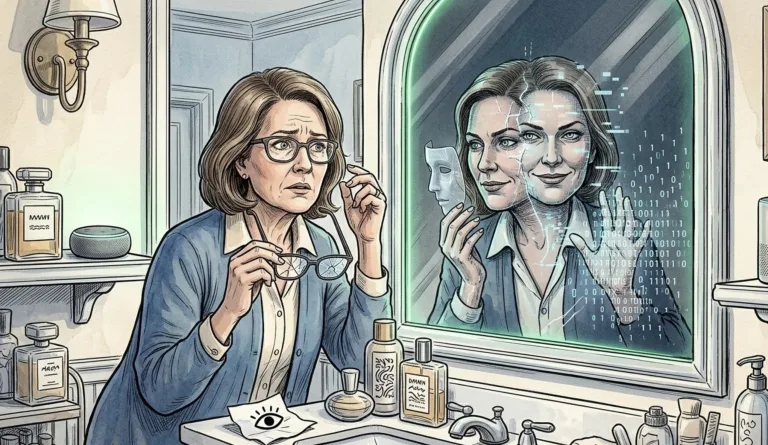

Vídeos e imagens produzidos com inteligência artificial, capazes de reproduzir rostos, vozes e expressões com aparência realista, estão se multiplicando na internet. As chamadas deepfakes deixaram de ser experimentos técnicos restritos a pesquisadores e passaram a circular em redes sociais, aplicativos e plataformas de vídeo com velocidade crescente.

O fenômeno acompanha a popularização de ferramentas de inteligência artificial generativa, que hoje permitem criar conteúdos sintéticos com poucos comandos. Especialistas apontam que o avanço da tecnologia não é o único fator de preocupação. A facilidade de acesso também ampliou o alcance desse tipo de material.

O que são deepfakes

O termo deepfake combina duas ideias centrais da tecnologia. A primeira vem de deep learning, área da inteligência artificial baseada em aprendizado profundo de máquinas. A segunda é fake, palavra em inglês que significa falso.

Na prática, os sistemas utilizam grandes volumes de dados para aprender padrões de voz, rosto e movimentos. A partir desses padrões, algoritmos conseguem gerar vídeos, imagens ou áudios que simulam pessoas reais dizendo ou fazendo algo que nunca ocorreu.

Hoje qualquer pessoa consegue produzir conteúdo sintético muito convincente com ferramentas disponíveis na internet.

Até poucos anos atrás, criar esse tipo de material exigia conhecimento técnico avançado e equipamentos com grande capacidade de processamento. Com o avanço das plataformas de inteligência artificial, esse processo se tornou mais simples e acessível.

Casos virais mostram alcance da tecnologia

O crescimento das deepfakes ficou evidente em episódios recentes que circularam nas redes sociais. Um dos exemplos citados por especialistas envolve um vídeo falso atribuído ao técnico da seleção brasileira, Carlo Ancelotti, que viralizou durante o Carnaval.

A gravação mostrava uma cena que nunca aconteceu. Mesmo assim, muitos usuários compartilharam o conteúdo acreditando que se tratava de um registro real.

Esse tipo de situação revela um dos principais desafios da nova fase da internet: a dificuldade crescente em verificar rapidamente a autenticidade de imagens e vídeos que circulam online.

Riscos vão além de vídeos virais

Embora parte das deepfakes apareça como entretenimento ou paródia, pesquisadores alertam que o impacto potencial vai muito além de conteúdos virais.

Entre os riscos frequentemente citados estão:

- Manipulação de informações públicas

- Golpes financeiros com uso da imagem de pessoas conhecidas

- Criação de conteúdos abusivos como deepnudes

- Disseminação de desinformação em períodos eleitorais

No Brasil, especialistas já identificaram casos de vídeos manipulados que utilizam a imagem de figuras públicas em anúncios falsos de produtos ou promessas de investimento. Em alguns episódios, o material foi utilizado para aplicar golpes online.

Plataformas buscam formas de identificar conteúdos manipulados

Empresas de tecnologia e pesquisadores discutem diferentes estratégias para tentar limitar a circulação de deepfakes.

Entre as soluções em desenvolvimento estão mecanismos de marca d’água invisível em imagens geradas por inteligência artificial e sistemas de metadados que registram o histórico de edição de arquivos digitais.

A ideia é permitir que plataformas e usuários identifiquem se um conteúdo foi criado ou alterado por ferramentas de inteligência artificial.

| Solução proposta | Objetivo |

| Marca d’água invisível | Indicar que a imagem foi gerada por IA |

| Metadados de edição | Registrar alterações feitas no arquivo |

| Sistemas de detecção | Identificar sinais de manipulação digital |

Especialistas alertam, no entanto, que essas soluções técnicas podem ser contornadas com relativa facilidade à medida que novas ferramentas são desenvolvidas.

Debate envolve tecnologia e regulação

A discussão sobre deepfakes passou a envolver também questões regulatórias. Pesquisadores defendem que empresas responsáveis por plataformas digitais e ferramentas de inteligência artificial adotem mecanismos mais rigorosos de controle e transparência.

O tema ganha peso adicional em contextos sensíveis, como campanhas eleitorais ou grandes eventos públicos, nos quais vídeos manipulados podem influenciar debates ou espalhar informações falsas.

À medida que ferramentas de inteligência artificial continuam evoluindo, pesquisadores avaliam que o principal desafio será desenvolver formas confiáveis de verificação digital. Enquanto soluções técnicas e regras ainda estão em debate, vídeos manipulados seguem circulando com rapidez nas redes sociais e em aplicativos de mensagens.